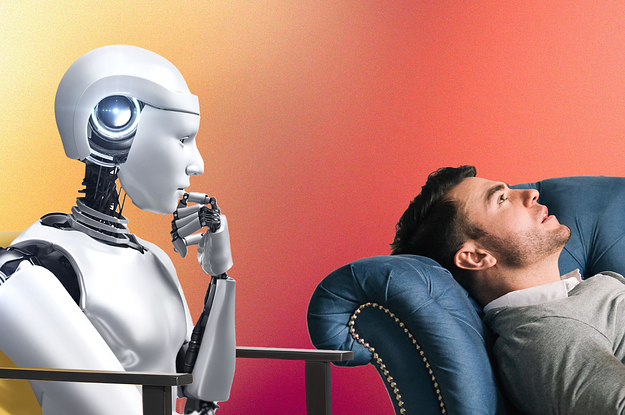

「我開始思考,我可以使用 ChatGPT API 建立一個人工智慧治療師,並對其進行調整以滿足治療師的規範,」她說。 “它通過提供免費和保密的治療、人工智能而不是人類來增加治療的可及性,並消除那些不想與人類交談的人獲得幫助的恥辱。”

理論上,人工智慧可以用來幫助滿足對心理健康選擇不斷增長的需求,以及滿足這些需求的心理健康專業人員的缺乏。 「可及性只是供需不匹配的問題,」艾耶告訴 BuzzFeed News。 “從技術上講,人工智慧的供應可能是無限的。”

2021 年《SSM 人口健康》雜誌發表的一項研究涉及 50,103 名成年人, 95.6% 的人表示至少有一項障礙 醫療保健,例如無力支付費用。有心理健康問題的人似乎特別受到醫療保健障礙的影響,包括 成本, 專家短缺和恥辱。

在 2017 年的一項研究中,有色人種尤其 容易受到醫療保健障礙的影響 後果 種族和民族差異,包括高水準的 心理健康恥辱、語言障礙、歧視和缺乏健康保險。

人工智慧的優點之一是程式可以轉化為 95種語言 幾秒鐘之內。

「Em 的用戶來自世界各地,由於 ChatGPT 可以翻譯成多種語言,我注意到人們使用自己的母語與 Em 進行交流,這非常有用,」Brendle 說。

布倫德爾說,另一個優點是,雖然人工智慧無法提供真正的情感同理心,但它也無法評斷你。

布倫德爾說:“根據我的經驗,人工智慧往往不帶偏見,這為了解人性的複雜性打開了一扇哲學之門。” “儘管治療師表現得不帶偏見,但作為人類,我們無論如何都會如此。”

這是不該使用人工智慧的時候

然而,心理健康專家警告說,對於那些尋求更深入資訊、需要藥物選擇或處於危機中的人來說,人工智慧可能弊大於利。

「對這些人工智慧模型進行可預測的控制仍然是一項仍在研究中的事情,因此我們不知道人工智慧系統會以何種意想不到的方式犯下災難性的錯誤,」艾耶說。 「由於這些系統不知道真假或好壞,只是簡單地報告他們之前讀過的內容,因此人工智慧系統完全有可能讀到一些不適當和有害的內容,並向尋求幫助的人重複這些有害內容。現在完全了解這裡的風險還為時過早。

TikTok 上的人們也表示,應該對線上工具進行調整——例如,他們說,人工智慧聊天可以在其回應中提供更有用的回饋。

「ChatGPT 通常不願意給出明確的答案或對人類治療師可能能夠提供的情況做出判斷,」凱拉說。 “此外,ChatGPT 在某種程度上缺乏為用戶可能忽視的情況提供新視角的能力,而人類治療師可能能夠看到這一點。”

雖然一些精神科醫生認為 ChatGPT 可能是了解更多藥物知識的有用方法,但它不應該是治療的唯一步驟。

「最好考慮向 ChatGPT 詢問有關藥物的信息,就像在維基百科上查找信息一樣,」Torous 說。 「找到合適的藥物是將其與您的需求和身體相匹配,而維基百科或 ChatGPT 目前都無法做到這一點。但您也許能夠了解更多有關藥物的一般知識,以便以後做出更明智的決定。

還有其他選擇,包括致電 988, 免費危機熱線。危機熱線為那些無法在其所在地區找到心理健康資源或沒有經濟能力親自聯繫的人提供電話和簡訊選項。此外,還有 特雷弗專案熱線, SAMHSA 全國求助專線, 和 其他的。

「確實有很多很棒且易於使用的資源,例如撥打 988 尋求幫助,這是在危機時的不錯選擇,」Torous 說。 “不建議在危機期間使用這些聊天機器人,因為你不想依賴未經測試的東西,甚至在你最需要幫助時也沒有設計來提供幫助。”

我們採訪的心理健康專家表示,人工智慧療法可能是發洩情緒的有用工具,但在做出更多改進之前,它無法超越人類專家。

「目前,對於那些尋求免費治療的人來說,像 ChatGPT 這樣的計畫並不是一個可行的選擇。他們可以提供一些基本支持,這很好,但不能提供臨床支持,」托羅斯說。 “即使是 ChatGPT 和相關程序的製造商也非常明確,目前不會將其用於治療。”

在美國請撥打 988 聯絡國家預防自殺生命線。 Trevor 計畫為 LGBTQ 青少年提供協助和自殺預防資源,電話:1-866-488-7386。在 Befrienders Worldwide (befrienders.org) 上尋找其他國際自殺求助專線。